რამდენიმე ათწლეულია არსებობს მოსაზრება, რომ ხელოვნური ინტელექტი კაცობრიობას დაჯაბნის. ახლახან, მეცნიერებმა ამის შესახებ საკუთარი ვერდიქტი დადეს — შეგვეძლება თუ არა მაღალი დონის კომპიუტერული სუპერინტელექტის კონტროლი. პასუხი? თითქმის გადაჭრით შეიძლება ითქვას, რომ არა.

საქმე ის არის, რომ ადამიანის აღქმაზე გაცილებით შორს მდგომი სუპერინტელექტის კონტროლი მოითხოვს ამ სუპერინტელექტის სუმულაციას, რომლის გაანალიზებასაც შევძლებთ. თუმცა, თუ მის გაგებას ვერ შევძლებთ, ასეთი სიმულაციის შექნაც შეუძლებელია.

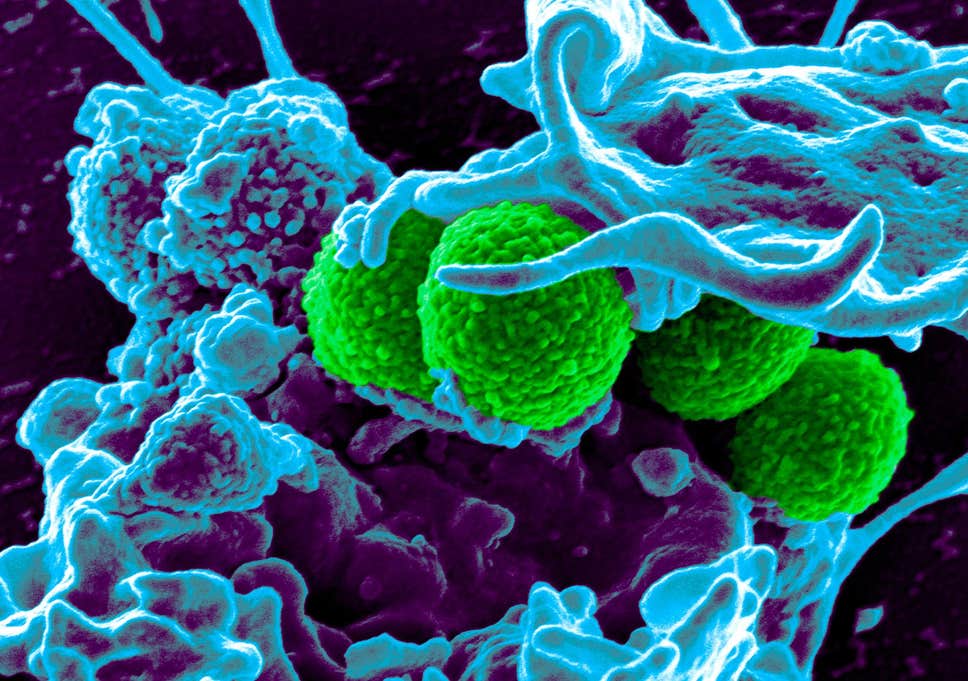

კვლევის ავტორთა განცხადებით, თუ ვერ ვიგებთ, რა სცენარით შეიძლება წავიდეს ხელოვნური ინტელექტი, სიმულაციაში ვერ დავაყენებთ ისეთ წესსაც, როგორიც იქნებოდა „არ ვნებს ადამიანებს“. თუ კომპიუტერული სისტემა ჩვენს პროგრამისტთა შესაძლებლობებზე მაღლა მუშაობს, ვერ დავუწესებთ ლიმიტებსაც.

„სუპერინტელექტი იმაზე ფუნდამენტურად განსხვავებული პრობლემების წინაშეა, რომლებსაც ტიპურად სწავლობენ „რობოტების ეთიკის“ დროშის ქვეშ“, — წერენ მკვლევრები.

მათივე განცხადებით, ამის მიზეზი ის არის, რომ სუპერინტელექტი მრავალმხრივია და შესაბამისად, პოტენციურად შეუძლია სხვადასხვა რესურსთა მობილიზება იმ მიზნების მისაღწევად, რომლებიც ადამიანთა გონებისთვის პოტენციურად აღუქმელია.

ჯგუფის არგუმენტაციის ნაწილი მომდინარეობს 1936 წელს ალან ტიურინგის მიერ შემუშავებული შეჩერების პრობლემიდან. პრობლემა ეფუძნება იმის ცოდნას, კომპიუტერული პროგრამა დასკვნას და პასუხს მიაღწევს (შესაბამისად, შეჩერდება) თუ სამუდამოდ ერთის მოძებნას შეეცდება.

როგორც ტიურინგმა გამჭრიახად გათვალა, მართალია, ვიცით, რომ ზოგიერთი პროგრამების შემთხვევაში ლოგიკურად შეუძლებელია იმ გზის პოვნა, რომელიც ყველა იმ პოტენციური პროგრამის შესახებ გვეტყვის, რომლებიც მომავალში შეიძლება დაიწეროს. ამას კი ისევ უკან, ხელოვნურ ინტელექტთან მივყავართ, რომელსაც სუპერინტელექტუალურ მდგომარეობაში უნდა შეეძლოს საკუთარ მეხსიერებაში ერთდროულად ჰქონდეს ყველა შესაძლო კომპიუტერული პროგრამა.

მაგალითად, ხელოვნური ინტელექტის მიერ ადამიანთათვის და მსოფლიოსთვის მიყენებული ზიანის აღსაკვეთად დაწერილმა ნებისმიერმა პროგრამამ შეიძლება მიაღწიოს დასკვნას (და შეჩერებას) ან ვერა — მათემატიკურად შეუძლებელია, ამაში აბსოლუტურად დარწმუნებული ვიყოთ, რაც იმას ნიშნავს, რომ ის შეჩერებადი არ არის.

„უფრო მეტიც, ეს შეჩერების ალგორითმს გამოუსადეგარს ხდის“, — ამბობს გერმანიის მაქს პლანკის ადამიანური განვითარების ინსტიტუტის კომპიუტერული მეცნიერი იად რაჰვანი.

მკვლევართა განცხადებით, ხელოვნური ინტელექტისთვის გარკვეული ეთიკისა და იმის ბრძანების ალტერნატივა, რომ მსოფლიო არ გაანადგუროს — რაღაც ისეთი, რომლის გაკეთებაც გადაჭრით არც ერთ ალგორითმს არ შეუძლია — არის სუპერინტელექტის შესაძლებლობათა შეზღუდვა. ეს შეიძლება იყოს მაგალითად, რაღაც ნაწილის გათიშვა ინტერნეტიდან ან გარკვეული ქსელებიდან.

ახალი კვლევა ამ იდეასაც უარყოფს იმის ვარაუდით, რომ ის ხელოვნური ინტელექტის შესაძლებლობას შეზღუდავს; არგუმენტი კი ის არის, რომ თუ ადამიანთა შესაძლებლობებს მიღმა არსებული პრობლემების გადასაჭრელად მის გამოყენებას არ ვაპირებთ, რატომ უნდა შევქმნათ ის საერთოდ?

თუ ხელოვნური ინტელექტის პროგრესირებას ვაპირებთ, შეიძლება ისიც არ ვიცოდეთ, როდის გამოჩნდება ჩვენს კონტროლს მიღმა მდგარი სუპერინტელექტი, მაგალითად, ისეთი, რომელიც ჩვენს აღქმას აღემატება. ეს კი იმას ნიშნავს, რომ საჭიროა კითხვების დასმა დავიწყოთ იმ მიმართულებათა შესახებ, საითაც მივდივართ.

„სუპერჭკვიანი მანქანა, რომელიც მსოფლიოს აკონტროლებს, სამეცნიერო ფანტასტიკას ჰგავს. თუმცა, უკვე არსებობს მანქანები, რომლებიც გარკვეულ მნიშვნელოვან დავალებებს დამოუკიდებლად ასრულებენ, ისე, რომ პროგრამისტები ბოლომდე ვერ იგებენ, როგორ ისწავლეს მათ ეს“, — ამბობს მაქს პლანკის ადამიანური განვითარების ინსტიტუტის კომპიუტერული მეცნიერი მანუელ სებრიანი.

მისივე თქმით, ახლა კითხვა იმაში მდგომარეობს, გახდება თუ არა ის გარკვეულ მომენტში უკონტროლო და კაცობრიობისთვის საშიში.

კვლევა Journal of Artificial Intelligence Research-ში გამოქვეყნდა.

მომზადებულია ScienceAlert-ის მიხედვით.